Обзор технологии G-Sync | Краткая история фиксированной частоты обновления

Давным-давно мониторы были громоздкими и содержали электронно-лучевые трубки и электронные пушки. Электронные пушки бомбардируют экран фотонами для освещения цветных люминофорных точек, которые мы зовём пикселями. Они прорисовывают слева направо каждую "сканирующую" строку от верхней до нижней. Регулировка скорости электронной пушки от одного полного обновления до следующего не очень практиковалась ранее, да и особой нужды до появления трёхмерных игр в этом не было. Поэтому ЭЛТ и связанные с ними аналоговые стандарты видео были разработаны с фиксированной частотой обновления.

ЖК-мониторы постепенно заменили ЭЛТ, а цифровые разъёмы (DVI, HDMI и DisplayPort) заменили аналоговые (VGA). Но ассоциации, отвечающие за стандартизацию видеосигналов (во главе с VESA), не перешли с фиксированной частоты обновления. Кино и телевидение по-прежнему опираются на входящий сигнал с постоянной частотой кадров. И снова переход на регулируемую частоту обновления не кажется столь необходимым.

Регулируемые частоты кадров и фиксированные частоты обновления не совпадают

До появления современной 3D-графики фиксированная частота обновления проблемой для дисплеев не являлась. Но она возникла, когда мы впервые столкнулись с мощными графическими процессорами: частота, на которой GPU визуализировал отдельные кадры (что мы называем частотой кадров, обычно выражающейся в FPS или кадрах в секунду), непостоянна. Она меняется с течением времени. В тяжёлых графических сценах карта может обеспечивать 30 FPS, а если смотреть на пустое небо - 60 FPS.

Отключение синхронизации приводит к разрывам

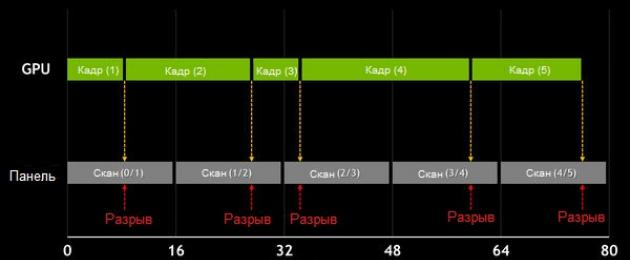

Выходит, что переменная частота кадров графического процессора и фиксированная частота обновления ЖК-панели вместе работают не очень хорошо. В такой конфигурации мы сталкиваемся с графическим артефактом под названием "разрыв". Он появляется, когда два и более неполных кадра визуализируются вместе в течение одного цикла обновления монитора. Обычно они смещаются, что даёт очень неприятный эффект во время движения.

На изображении выше показаны два хорошо известных артефакта, которые часто встречаются, но их трудно зафиксировать. Поскольку это артефакты дисплея, на обычных игровых скриншотах вы такого не увидите, однако наши снимки показывают, что вы на самом деле видите во время игры. Чтобы их снять, нужна камера с высокоскоростным режимом съёмки. Или если у вас есть карта с поддержкой видеозахвата, вы можете записать несжатый поток видео с порта DVI и чётко увидеть переход от одного кадра к другому; именно этот способ мы используем для тестов FCAT. Однако лучше всего наблюдать описанный эффект собственными глазами.

Эффект разрыва виден на обоих изображениях. Верхнее сделано с помощью камеры, нижнее - через функцию видеозахвата. Нижняя картинка "разрезана" по горизонтали и выглядит смещённой. На верхних двух изображениях левый снимок сделан на экране Sharp с частотой обновления 60 Гц, правый – на дисплее Asus с частотой 120 Гц. Разрыв на 120-герцевом дисплее выражен не так сильно, поскольку частота обновления вдвое выше. Тем не менее, эффект виден, и проявляется так же, как и на левом изображении. Артефакт такого типа – явный признак того, что изображения были сделаны при отключённой вертикальной синхронизации (V-sync).

Battlefield 4 на GeForce GTX 770 с отключённой V-sync

Второй эффект, который виден на снимках BioShock: Infinite, называется двоение (ghosting). Он особенно хорошо виден в нижней части левого снимка и связан с задержкой обновления экрана. Если коротко, то отдельные пиксели не достаточно быстро меняют цвет, что приводит к свечению такого типа. Отдельно взятый кадр не может передать, какой эффект двоение оказывает на саму игру. Панель со временем отклика от серого к серому 8 мс, такая как Sharp, будет в результате давать размытое изображение при любом движении на экране. Вот почему эти дисплеи, как правило, не рекомендуют для шутеров от перового лица.

V-sync: "шило на мыло"

Вертикальная синхронизация, или V-sync – это очень старое решение проблемы разрывов. При активации этой функции видеокарта пытается соответствовать частоте обновления экрана, полностью удаляя разрывы. Проблема в том, что если ваша видеокарта не сможет удержать частоту кадров выше 60 FPS (на дисплее с частотой обновления 60 Гц), эффективная частота кадров будет скакать между значениями, кратными частоте обновления экрана (60, 30, 20, 15 FPS и т.д.), что в свою очередь приведёт к ощутимым притормаживаниям.

Когда частота кадров падает ниже частоты обновления при активной V-sync, вы ощутите притормаживания

Более того, поскольку вертикальная синхронизация заставляет видеокарту ждать и иногда полагается на буфер невидимых поверхностей, V-sync может добавлять в цепочку визуализации дополнительную задержку ввода. Таким образом, V-sync может быть как спасением, так и проклятием, решая одни проблемы, но при этом провоцируя другие недостатки. Неофициальный опрос наших сотрудников показал, что геймеры, как правило, отключают вертикальную синхронизацию, и включают лишь тогда, когда разрывы становятся невыносимыми.

Креативный подход: Nvidia представляет G-Sync

При запуске новой видеокарты GeForce GTX 680 компания Nvidia включила режим драйвера под названием Adaptive V-sync (адаптивная вертикальная синхронизация), который пытается нивелировать проблемы при включении V-sync, когда частота кадров выше частоты обновления монитора и быстро отключая её, когда происходит резкое падение производительности ниже частоты обновления. Хотя технология добросовестно выполняла свои функции, это был лишь обход проблемы, который не позволял избавиться от разрывов, если частота кадров была ниже частоты обновления монитора.

Реализация G-Sync

гораздо интереснее. Если говорить в общем, Nvidia показывает, что вместо того, чтобы заставлять видеокарты работать на фиксированной частоте дисплея, мы можем заставить новые мониторы работать на непостоянной частоте.

Частота кадров GPU определяет частоту обновления монитора, убирая артефакты, связанные с включением и отключением V-sync

Пакетный механизм передачи данных разъёма DisplayPort открыл новые возможности. Используя переменные интервалы гашения в видеосигнале DisplayPort и заменяя устройство масштабирования монитора на модуль, работающий с переменными сигналами гашения, ЖК-панель может работать на переменной частоте обновления, связанной с частотой кадров, которую выводит видеокарта (в пределах частоты обновления монитора). На практике Nvidia креативно подошла к использованию особых возможностей интерфейса DisplayPort и попыталась поймать двух зайцев одновременно.

Ещё перед началом тестов хочется отдать должное за творческий подход к решению реальной проблемы, влияющей на игры на ПК. Это инновации во всей красе. Но каковы результаты G-Sync на практике? Давайте выяснять.

Nvidia прислала нам инженерный образец монитора Asus VG248QE , в котором устройство масштабирования заменено на модуль G-Sync . С этим дисплеем мы уже знакомы. Ему посвящена статья "Обзор Asus VG248QE: 24-дюймовый игровой монитор с частотой обновления 144 Гц за $400" , в которой монитор заработал награду Tom"s Hardware Smart Buy. Теперь пришло время узнать, как новая технология Nvidia повлияет на самые популярные игры.

Обзор технологии G-Sync | 3D LightBoost, встроенная память, стандарты и 4K

Просматривая материалы для прессы от Nvidia, мы задавали себе немало вопросов, как о месте технологии в настоящем, так и её роли в будущем. Во время недавней поездки в головной офис компании в Санта-Клара наши коллеги из США получили некоторые ответы.

G-Sync и 3D LightBoost

Первое, что мы заметили, - это то, что Nvidia прислала монитор Asus VG248QE , модифицированный для поддержки G-Sync . Этот монитор также поддерживает технологию Nvidia 3D LightBoost, которая изначально была разработана для повышения яркости 3D-дисплеев, но долгое время неофициально использовалась в 2D-режиме, применяя пульсирующую фоновую подсветку панели для уменьшения эффекта двоения (или размытия движений). Естественно, стало интересно, используется ли данная технология в G-Sync .

Nvidia дала отрицательный ответ. Хотя использование обеих технологий одновременно было бы идеальным решением, сегодня стробирование фоновой подсветки на переменной частоте обновления приводит к проблемам с мерцанием и яркостью. Решить их невероятно сложно, поскольку необходимо настроить яркость и отслеживать импульсы. Как результат, сейчас приходится выбирать между двумя технологиями, хотя компания пытается найти способ использовать их одновременно в будущем.

Встроенная память модуля G-Sync

Как мы уже знаем, G-Sync устраняет пошаговую задержку ввода, связанную с V-sync, поскольку больше нет необходимости ожидать завершения сканирования панели. Тем не менее, мы заметили, что модуль G-Sync имеет встроенную память. Модуль может буферизировать кадры самостоятельно? Если так, сколько времени потребуется кадру, чтобы пройди через новый канал?

По данным Nvidia, кадры не буферизуются в памяти модуля. По мере поступления данных они отображаются на экране, а память выполняет некоторые другие функции. Тем не менее, время обработки для G-Sync заметно меньше одной миллисекунды. Фактически почти с такой же задержкой мы сталкиваемся при выключённой V-sync, и она связана с особенностями игры, видеодрайвера, мышки и т.д.

Будет ли G-Sync стандартизирована?

Такой вопрос задавался в последнем интервью с AMD, когда читатель хотел узнать реакцию компании на технологию G-Sync . Однако нам захотелось спросить это непосредственно у разработчика и узнать, планирует ли Nvidia вывести технологию на промышленный стандарт. В теории компания может предлагать G-Sync как апгрейд для стандарта DisplayPort, обеспечивающего переменные частоты обновления. В конце концов, Nvidia является членом ассоциации VESA.

Однако новые спецификации для DisplayPort, HDMI или DVI не планируются. G-Sync и так поддерживает DisplayPort 1.2, то есть стандарт менять не нужно.

Как уже отмечалось, Nvidia работает над совместимостью G-Sync

с технологией, которая сейчас называется 3D LightBoost (но скоро будет носить другое имя). Кроме того, компания ищет способ снизить себестоимость модулей G-Sync

и сделать их более доступными.

G-Sync на разрешениях Ultra HD

Nvidia обещает появление мониторов с поддержкой G-Sync и разрешениями до 3840x2160 пикселей. Однако модель от Asus, которую мы сегодня рассмотрим, поддерживает только 1920x1080 точек. На данный момент мониторы Ultra HD используют контроллер STMicro Athena, имеющий два устройства масштабирования для создания поделённого на плитки дисплея. Нам интересно, будет ли модуль G-Sync поддерживать конфигурацию MST?

По правде говоря, дисплеев 4K с переменой частотой кадров ещё придётся подождать. Ещё не существует отдельного устройства масштабирования, поддерживающего разрешение 4K, ближайшее должно появиться в первой четверти 2014 года, а мониторы, ими оснащённые, - только во второй четверти. Поскольку модуль G-Sync заменяет устройство масштабирования, совместимые панели начнут появляться после этого момента. К счастью, модуль изначально поддерживает Ultra HD.

Что происходит до 30 Гц?

G-Sync может изменять частоту обновления экрана вплоть до 30 Гц. Объясняется это тем, что при очень низких частотах обновления экрана изображение на ЖК-экране начинает разрушаться, что приводит к появлению визуальных артефактов. Если источник обеспечивает менее 30 FPS, модуль будет обновлять панель автоматически, избегая возможных проблем. Это означает, что одно изображение может воспроизводиться более одного раза, но нижний порог составляет 30 Гц, что обеспечит максимальное качественное изображение.

Обзор технологии G-Sync | Панели 60 Гц, SLI, Surround и наличие

Технология ограничивается только панелями с высокой частотой обновления?

Вы заметите, что первый монитор с G-Sync изначально имеет очень высокую частоту обновления экрана (выше необходимого для технологии уровня) и разрешение 1920x1080 точек. Но дисплей Asus имеет собственные ограничения, например, 6-битную TN-панель. Нам стало любопытно, внедрение технологии G-Sync планируется только в дисплеях с высокой частотой обновления или мы сможем увидеть её на более распространённых 60-герцевых мониторах? Кроме того, хочется как можно быстрее получить доступ к разрешению 2560x1440 точек.

В Nvidia вновь повторили, что наилучший опыт от G-Sync можно получить тогда, когда ваша видеокарта удерживает частоту кадров в пределах 30 – 60 FPS. Таким образом, технология действительно может выгодно использовать обычные мониторы с частотой 60 Гц и модулем G-Sync .

Но зачем тогда использовать монитор на 144 Гц? Похоже, что многие производители мониторов решили внедрить функцию низкого размытия движения (3D LightBoost), требующую высокой частоты обновления. Но те, кто решил не использовать эту функцию (а почему бы и нет, ведь она пока не совместима с G-Sync ), могут создать панель с G-Sync за гораздо меньшие деньги.

Говоря о разрешениях, можно отметить, что всё складывается таким образом: QHD-экраны с частотой обновления более 120 Гц могут начать выпускаться уже в начале 2014 года.

Существуют ли проблемы с SLI и G-Sync?

Что нужно для того, чтобы увидеть G-Sync в режиме Surround?

Сейчас, конечно, не нужно объединять два графических адаптера, чтобы обеспечить вывод на экран изображения в качестве 1080p. Даже видеокарта среднего класса на базе Kepler сможет предоставить уровень производительности, необходимый для комфортной игры на этом разрешении. Но также нет возможности запустить две карты в SLI на трёх G-Sync -мониторах в режиме Surround.

Этот ограничение связано с современными выходами для дисплеев на картах Nvidia, которые, как правило, имеют два порта DVI, один HDMI и один DisplayPort. G-Sync требует наличия DisplayPort 1.2, и адаптер работать не будет (как и концентратор MST). Единственный вариант – это подключить три монитора в режиме Surround к трём картам, т.е. для каждого монитора отдельная карта. Естественно, мы предполагаем, что партнёры Nvidia начнут выпускать карты "G-Sync Edition" с большим количеством разъёмов DisplayPort.

G-Sync и тройная буферизация

Для комфортной игры с вертикальной синхронизацией требовалась активная тройная буферизация. Нужна ли она для G-Sync ? Ответ – нет. G-Sync не только не требует тройной буферизации, поскольку канал никогда не останавливается, она, наоборот, вредит G-Sync , поскольку добавляет дополнительный кадр задержки без прироста производительности. К сожалению, тройную буферизацию игры часто задают самостоятельно, и обойти вручную их нельзя.

А что насчёт игр, которые обычно плохо реагируют на отключение V-sync?

Игры типа Skyrim, которая является частью нашего тестового пакета, предназначены для работы с вертикальной синхронизацией на панели 60 Гц (хотя это иногда усложняет нам жизнь из-за задержки ввода). Для их тестирования требуется модификация определённых фалов с расширением.ini. Так как себя ведёт G-Sync с играми на базе движков Gamebryo и Creation, чувствительных к настройкам вертикальной синхронизации? Они ограничиваются 60 FPS?

Во-вторых, нужен монитор с модулем Nvidia G-Sync . Этот модуль заменяет масштабирующее устройство экрана. И, например, к разделённому Ultra HD-дисплею добавить G-Sync невозможно. В сегодняшнем обзоре мы используем прототип с разрешением 1920x1080 пикселей и частотой обновления до 144 Гц. Но даже с его помощью вы сможете составить представление о том, какое влияние будет иметь G-Sync , если производители начнут устанавливать его в более дешёвые панели на 60 Гц.

В-третьих, требуется наличие кабеля DisplayPort 1.2. DVI и HDMI не поддерживаются. В ближайшей перспективе это означает, что единственным вариантом для работы G-Sync на трёх мониторах в режиме Surround является их подключение через тройную связку SLI, поскольку у каждой карты есть лишь по одному разъёму DisplayPort, и адаптеры для DVI на DisplayPort в этом случае не работают. То же самое касается MST-концентраторов.

И, наконец, не стоит забывать про поддержку в драйверах. Последний пакет версии 331.93 beta уже имеет совместимость с G-Sync , и мы предполагаем, что и будущие версии с сертификатом WHQL будут ей оснащаться.

Тестовый стенд

| Конфигурация тестового стенда | |

| Процессор | Intel Core i7-3970X (Sandy Bridge-E), базовая частота 3,5 ГГц, разгон до 4,3 ГГц, LGA 2011, 15 Мбайт общего кэша L3, Hyper-Threading вкл., функции энергосбережения вкл. |

| Системная плата | MSI X79A-GD45 Plus (LGA 2011) X79 Express Chipset, BIOS 17.5 |

| Оперативная память | G.Skill 32 Гбайт (8 x 4 Гбайт) DDR3-2133, F3-17000CL9Q-16GBXM x2 @ 9-11-10-28 и 1,65 В |

| Накопитель | Samsung 840 Pro SSD 256 Гбайт SATA 6Гбит/с |

| Видеокарты | Nvidia GeForce GTX 780 Ti 3 Гбайт Nvidia GeForce GTX 760 2 Гбайт |

| Блок питания | Corsair AX860i 860 W |

| Системное ПО и драйверы | |

| ОС | Windows 8 Professional 64-bit |

| DirectX | DirectX 11 |

| Видеодрайвер | Nvidia GeForce 331.93 Beta |

Теперь необходимо разобраться, в каких случаях G-Sync оказывает самое большое воздействие. Велика вероятность, что вы уже сейчас используете монитор с частотой обновления 60 Гц. Среди геймеров более популярны модели с частотой 120 и 144 Гц, но Nvidia справедливо предполагает, что большая часть энтузиастов на рынке всё же будет придерживаться уровня 60 Гц.

При активной вертикальной синхронизации на мониторе с частотой обновления 60 Гц наиболее заметные артефакты появляются в тех случаях, когда карта не может обеспечить частоту 60 кадров в секунду, что приводит к раздражающим скачкам между 30 и 60 FPS. Здесь наблюдаются заметные притормаживания. При отключённой вертикальной синхронизации эффект разрывов будет больше всего заметен в сценах, где нужно часто вращать камерой или в которых происходит много движений. Некоторых игроков это настолько сильно отвлекает, что они просто включают V-sync и терпят притормаживания и задержки ввода.

При частоте обновления 120 и 144 Гц и более высокой частоте кадров дисплей обновляется чаще, сокращая время, когда один кадр сохраняется на протяжении нескольких сканирований экрана при недостаточной производительности. Однако проблемы с активной и неактивной вертикальной синхронизацией сохраняются. По этой причине мы будем тестировать монитор Asus в режиме 60 и 144 Гц с включённой и выключенной технологий G-Sync .

Обзор технологии G-Sync | Тестирование G-Sync с включённой V-Sync

Пришло время начать тестирование G-Sync . Остаётся только установить карту видеозахвата, массив из нескольких SSD и перейти к тестам, правильно?

Нет, неправильно.

Сегодня мы измеряем не производительность, а качество. В нашем случае тесты могут показать лишь одно: частоту кадров в конкретный момент времени. О качестве и опыте использования при включённой и выключенной технологии G-Sync они не говорят ровным счётом ничего. Поэтому придётся полагаться на наше тщательно выверенное и красноречивое описание, которые мы постараемся максимально приблизить к реальности.

Почему бы просто не записать видеоролик и не отдать его на суд читателям? Дело в том, что камера записывает видео на фиксированной скорости 60 Гц. Ваш монитор также воспроизводит видео на постоянной частоте обновления 60 Гц. Поскольку G-Sync внедряет переменную частоту обновления, технологию в действии вы не увидите.

Учитывая количество доступных игр, количество возможных тестовых комбинаций бесчисленно. V-sync вкл., V-sync выкл., G-Sync

вкл., G-Sync

выкл., 60 Гц, 120 Гц, 144 Гц, ... Список можно продолжать ещё долго. Но мы начнём с частоты обновления 60 Гц и активной вертикальной синхронизации.

Наверное, проще всего начать с собственной демонстрационной утилиты Nvidia, в которой маятник качается из стороны в сторону. Утилита может имитировать частоту кадров 60, 50 или 40 FPS. Или частота может колебаться между 40 и 60 FPS. Затем можно отключить или включить V-sync и G-Sync . Хотя тест и выдуманный, он хорошо демонстрирует возможности технологии. Можно наблюдать сцену при 50 FPS с включённой вертикальной синхронизацией и думать: "Всё вполне неплохо, и видимые притормаживания можно терпеть". Но после активации G-Sync сразу хочется сказать: "О чём я думал? Разница очевидна, как день и ночь. Как я мог жить с этим раньше?"

Но не будем забывать, что это техническая демонстрация. Хотелось бы доказательств на базе реальных игр. Для этого нужно запустить игру с высокими системными требованиями, такую как Arma III.

В Arma III можно установить в тестовую машину GeForce GTX 770 и выставить ультранастройки. С отключённой вертикальной синхронизацией частота кадров колеблется в пределах 40 – 50 FPS. Но если включить V-sync, она снизится до 30 FPS. Производительность недостаточно высока, чтобы наблюдались постоянные колебания между 30 и 60 FPS. Вместо этого частота кадров видеокарты просто уменьшается.

Поскольку притормаживания изображения не было, существенная разница при активации G-Sync

незаметна, за исключением того, что реальная частота кадров подскакивает на 10 - 20 FPS выше. Задержка ввода также должна понизиться, поскольку один и тот же кадр не сохраняется на протяжении нескольких сканирований монитора. Нам кажется, что Arma вообще менее "дёрганная", чем многие другие игры, так что задержка не чувствуется.

С другой стороны, в Metro: Last Light влияние G-Sync более выражено. С видеокартой GeForce GTX 770 игру можно запустить при разрешении 1920x1080 точек с очень высокими настройками детализации, включая 16x AF, нормальную тесселяцию и размытие движений. В этом случае можно выбирать параметры SSAA с 1x до 2x до 3x, чтобы постепенно снижать частоту кадров.

Кроме того, окружение игры включает прихожую, в которой легко "стрейфить" вперёд и назад. Запустив уровень с активной вертикальной синхронизацией на 60 Гц, мы вышли в город. Fraps показал, что с трёхкратным сглаживанием SSAA частота кадров составила 30 FPS, а при отключённом сглаживании - 60 FPS. В первом случае ощутимы притормаживания и задержки. С отключённым SSAA вы получите абсолютно плавную картинку на 60 FPS. Однако активация 2x SSAA, приводит к колебаниям от 60 до 30 FPS, из чего каждый продублированный кадр создаёт неудобства. Это одна из игр, в которой мы бы обязательно отключили вертикальную синхронизацию и просто игнорировали разрывы. У многих всё равно уже выработалась привычка.

Однако G-Sync избавляет от всех негативных эффектов. Вам больше не придётся смотреть в счётчик Fraps в ожидании проседаний ниже 60 FPS, чтобы понизить ещё один графический параметр. Вы, наоборот, можете повысить некоторые из них, поскольку даже в случае замедления до 50 - 40 FPS очевидных притормаживаний не будет. А что, если отключить вертикальную синхронизацию? Об этом вы узнаете позже.

Обзор технологии G-Sync | Тестирование G-Sync с отключённой V-Sync

Выводы в этом материале созданы на основе опроса авторов и друзей Tom"s Hardware по Skype (другими словами, выборка опрашиваемых небольшая), но почти все они понимают, что такое вертикальная синхронизация и с какими недостаткам приходится в той связи мириться пользователям. По их словам, они прибегают к помощи вертикальной синхронизации лишь в том случае, когда разрывы из-за сильно большого разброса в частоте кадров и частоте обновления монитора становятся невыносимыми.

Как вы можете себе представить, влияние выключенной вертикальной синхронизации на визуальную составляющую сложно перепутать, хотя на это сильно влияют конкретная игра и её настройки детализации.

Возьмём, например, Crysis 3 . Игра с лёгкостью может поставить на колени вашу графическую подсистему на самых высоких параметрах графики. И, поскольку Crysis 3 является шутером от первого лица с очень динамичным геймплеем, разрывы могут быть довольно ощутимыми. На примере выше вывод FCAT был захвачен между двумя кадрами. Как видите, дерево полностью разрезано.

С другой стороны, когда мы принудительно отключаем вертикальную синхронизацию в Skyrim, разрывы не такие уж и сильные. Учтите, что в этом случае частота кадров очень высокая, и несколько кадров появляются на экране с каждым сканированием. Таким обзорам, количество движений на кадр относительно низкое. При игре в Skyrim в такой конфигурации существуют проблемы, и, возможно, она не самая оптимальная. Но она показывает, что даже при отключённой вертикальной синхронизации ощущение от игры может меняться.

В качестве третьего примера мы выбрали кадр с изображением плеча Лары Крофт из игры Tomb Raider, на котором виден довольно чёткий разрыв изображения (также посмотрите на волосы и лямку майки). Tomb Raider – единственная игра из нашей выборки, которая позволяет выбирать между двойной и тройной буферизацией при активации вертикальной синхронизации.

Последний график показывает, что Metro: Last Light с G-Sync при 144 Гц, в целом, обеспечивает такую же производительность, как при отключённой вертикальной синхронизации. Однако на графике нельзя увидеть отсутствие разрывов. Если использовать технологию с экраном 60 Гц, частота кадров упрётся в 60 FPS, но при этом не будет притормаживаний или задержек.

Во всяком случае, те из вас (и нас), кто провёл несчётное количество времени за графическими тестами, наблюдая один и тот же бенчмарк снова и снова, могли привыкнуть к ним и визуально определить, насколько хорош тот или иной результат. Так мы измеряем абсолютную производительность видеокарт. Изменения в картинке с активной G-Sync сразу бросаются в глаза, поскольку появляется плавность, как при включённой V-sync, но без разрывов, свойственных для отключённой V-sync. Жаль, что сейчас мы не можем показать разницу в видеоролике.

Обзор технологии G-Sync | Совместимость с играми: почти великолепно

Проверяем другие игры

Мы протестировали ещё несколько игр. Crysis 3 , Tomb Raider, Skyrim, BioShock: Infinite, Battlefield 4 побывали на тестовом стенде. Все они, кроме Skyrim, выиграли от технологии G-Sync . Эффект зависел от конкурентной игры. Но если бы вы видели его, сразу бы признали, что игнорировали недостатки, которые присутствовали ранее.

Артефакты всё же могут появляться. Например, эффект сползания, связанный со сглаживанием, при плавном движении заметен сильнее. Скорее всего, вам захочется выставить сглаживание как можно выше, чтобы убрать неприятные неровности, которые раньше были не так заметны.

Skyrim: особый случай

Графический движок Creation, на котором разработана Skyrim, активирует вертикальную синхронизацию по умолчанию. Чтобы тестировать игру на частоте кадров выше 60 FPS, в один из.ini-файлов игры нужно добавить строку iPresentInterval=0.

Таким образом, Skyrim можно тестировать тремя способами: в исходном состоянии, позволяя драйверу Nvidia "использовать настройки приложения ", включить G-Sync

в драйвере и оставить настройки Skyrim нетронутыми, а затем включить G-Sync

и отключить V-sync в файле игры с расширением.ini.

Первая конфигурация, в которой опытный монитор выставлен на 60 Гц, показала стабильные 60 FPS на ультранастройках с видеокартой GeForce GTX 770 . Следовательно, мы получили плавную и приятную картинку. Тем не менее, ввод от пользователя по-прежнему страдает от задержки. Кроме того, стрейф из стороны в сторону выявил заметное размытие движений. Однако именно таким образом на ПК играет большинство людей. Конечно, вы можете купить экран с частотой обновления 144 Гц, и он реально устранит размытие. Но поскольку GeForce GTX 770 обеспечивает частоту обновления на уровне примерно 90 - 100 кадров в секунду, появятся ощутимые притормаживания, когда движок будет колебаться между 144 и 72 FPS.

При 60 Гц G-Sync имеет негативное влияние на картинку, вероятно, это связано с активной вертикальной синхронизацией, при том, что технология должна работать с отключённой V-sync. Теперь боковой стрейф (особенно ближе к стенам) приводит к выраженным притормаживаниям. Это потенциальная проблема для 60-герцевых панелей с G-Sync , по крайней мере, в таких играх как Skyrim. К счастью, в случае с монитором Asus VG248Q можно переключиться в режим 144 Гц, и, несмотря на активную V-sync, G-Sync будет работать на такой частоте кадров без нареканий.

Полное отключение вертикальной синхронизации в Skyrim приводит к более "чёткому" управлению мышью. Однако при этом появляются разрывы изображения (не говоря о других артефактах, таких как мерцающая вода). Включение G-Sync оставляет притормаживания на уровне 60 Гц, но на 144 Гц ситуация значительно улучшается. Хотя в обзорах видеокарт мы тестируем игру с отключённой вертикальной синхронизацией, мы не рекомендовали бы играть без неё.

Для Skyrim, возможно, самым лучшим решением будет отключить G-Sync и играть на 60 Гц, что даст постоянные 60 кадров в секунду на выбранных вам настройках графики.

Обзор технологии G-Sync | G-Sync – то, что вы ждали?

Даже перед тем, как мы получили тестовый образец монитора Asus с технологий G-Sync , нас уже порадовал тот факт, что Nvidia работает над вполне реальной проблемой, влияющей на игры, решения которой ещё не было предложено. До сих пор вы на свой вкус могли включать или не включать вертикальную синхронизацию. При этом любой решение сопровождалось компромиссами, негативно влияющими на игровой опыт. Если вы предпочитаете не включать вертикальную синхронизацию до тех пор, пока разрывы изображения станут невыносимыми, то можно сказать, что вы выбираете меньшее из двух зол.

G-Sync решает проблему, предоставляя монитору возможность сканировать экран на переменной частоте. Такие инновации – единственный способ и дальше продвигать нашу индустрию, сохраняя техническое преимущество персональных компьютеров над игровыми консолями и платформами. Nvidia, без сомнения, выдержит критику за то, что не разработала стандарт, который могли бы применить конкуренты. Тем не менее, для своего решения компания использует DisplayPort 1.2. В результате всего через два месяца после анонса технологии G-Sync она оказалась у нас в руках.

Вопрос в том, реализует ли Nvidia всё, что обещала в G-Sync?

Три талантливых разработчика, расхваливающие качества технологии, которую вы ещё не видели в действии, могут вдохновить кого угодно. Но если ваш первый опыт с G-Sync основан на демонстрационном тесте с маятником от Nvidia, вы точно зададитесь вопросом, возможна ли вообще такая огромная разница, или же тест представляет особый сценарий, который слишком хорош, чтобы быть правдой.

Естественно, при проверке технологии в реальных играх эффект оказывается не таким однозначным. С одной стороны, были возгласы "Ого!" и "С ума сойти!", с другой - "Кажется, я вижу разницу". Лучше всего влияние активации G-Sync заметно при смене частоты обновления дисплея с 60 Гц на 144 Гц. Но мы также пытались провести тест на 60 Гц с G-Sync , чтобы узнать, что вы получите (надеемся) с более дешёвыми дисплеями в будущем. В некоторых случаях простой переход с 60 на 144 Гц вас сильно поразит, особенно если ваша видеокарта может обеспечить высокую частоту кадров.

Сегодня нам известно, что Asus планирует внедрить поддержку G-Sync

в модели Asus VG248QE

, которая, по словам компании, в следующем году будет продаваться по цене $400. Монитор имеет родное разрешение 1920x1080 пикселей и частоту обновления 144 Гц. Версия без G-Sync

уже получила нашу награду Smart Buy за выдающуюся производительность. Но лично для нас 6-битная TN-панель является недостатком. Очень хочется видеть 2560x1440 пикселей на IPS-матрице. Мы даже согласны на частоту обновления 60 Гц, если это поможет снизить цену.

Хотя на выставке CES мы ждём целую кучу анонсов, официальных комментариев Nvidia касательно других дисплеев с модулями G-Sync и их цен мы не слышали. Кроме того, мы не уверены, каковы планы компании насчёт модуля для апгрейда, который должен позволить вам внедрить модуль G-Sync в уже купленный монитор Asus VG248QE за 20 минут.

Сейчас мы можем сказать, что стоит подождать. Вы увидите, что в одних играх влияние новой технологий нельзя перепутать, а в других оно менее выражено. Но в любом случае G-Sync отвечает на "бородатый" вопрос, включать или не включать вертикальную синхронизацию.

Есть ещё одна интересная мысль. После того, как мы протестировали G-Sync

, сколько ещё AMD сможет уклоняться от комментариев? Компания подразнила наших читателей в своём интервью

(англ.), отметив, что она скоро определиться с этой возможностью. Если у неё что-нибудь в планах? Конец 2013 года и начало 2014 года готовят нам множество интересных новостей для обсуждения, включая Battlefield 4

Mantle-версии, предстоящую архитектуру Nvidia Maxwell, G-Sync

, движок AMD xDMA с поддержкой CrossFire и слухи о новых двухчиповых видеокартах. Сейчас нам не хватает видеокарт, объём памяти GDDR5 которых больше чем 3 Гбайт (Nvidia) и 4 Гбайт (AMD), но стоят они меньше $1000...

Настольный ПК, подключенный к монитору с технологией G-SYNC:

Поддерживаемые видеокарты:

Технология G-SYNC поддерживается на GPU NVIDIA GeForce ® GTX 650Ti BOOST и выше.

Драйвер:

Операционная система:

- Windows 10

- Windows 8.1

- Windows 7

Системные требования:

Ноутбук, подключенный к монитору с технологией G-SYNC:

Поддерживаемые видеокарты:

GPU NVIDIA GeForce ® GTX 980M, GTX 970M, GTX 965M или выше.

Драйвер:

R340.52 или более поздняя версия

Операционная система:

- Windows 10

- Windows 8.1

- Windows 7

Системные требования: Необходима поддержка DisplayPort 1.2 непосредственно на GPU.

Ноутбук с дисплеем с поддержкой G-SYNC:

Ноутбук должен поддерживать технологию G-SYNC. Узнайте у производителя, поддерживает ли ваш ноутбук технологию G-SYNC. Ниже представлены минимальные системные требования для ноутбуков с поддержкой технологии G-SYNC.

Поддерживаемые видеокарты:

GPU NVIDIA GeForce ® GTX 980M, GTX 970M, GTX 965M или выше. Конфигурация SLI так же поддерживается.

Драйвер:

R352.06 или более поздняя версия

Операционная система:

- Windows 10

- Windows 8.1

- Windows 7

Системные требования: Необходима поддержка DisplayPort 1.2 непосредственно на GPU.

СИСТЕМНЫЕ ТРЕБОВАНИЯ ДЛЯ G-SYNC HDR

Настольный ПК, подключенный к монитору с технологией G-SYNC HDR:

Поддерживаемые видеокарты:

Технология G-SYNC HDR поддерживается на GPU NVIDIA GeForce ® GTX 1050 и выше. 1

Драйвер:

Операционная система:

- Windows 10

Системные требования:

Примечание 1: убедитесь, что у вас установлены последние версии драйверов и программного обеспечения для GPU. Для этого зайдите на: http://www.nvidia.ru/object/nv-uefi-update-x64.html

Ноутбук, подключенный к монитору с технологией G-SYNC HDR:

Поддерживаемые видеокарты:

Технология G-SYNC HDR поддерживается на GPU NVIDIA GeForce ® GTX 1050 и выше.

Драйвер:

R396 GA2 или более поздняя версия

Операционная система:

- Windows 10

Системные требования: Необходима поддержка DisplayPort 1.4 непосредственно на GPU.

В те старые добрые времена, когда владельцы персональных компьютеров активно использовали громадные ЭЛТ-мониторы, зарабатывая себе астигматизм, о плавности изображения никакой речи идти не могло. Тогдашние технологии не очень поддерживали и 3D. Поэтому бедным юзерам приходилось довольствоваться тем, что было. Но время идет, технологии развиваются, и многих уже не устраивает разрыв кадра (тиринг) при динамической игре. Особенно это касается так называемых кибер-спортсменов. В их случае доли секунды решают все. Как быть?

Прогресс на месте не стоит. Поэтому то, что раньше казалось невозможным, сейчас может восприниматься как должное. Та же ситуация и с качеством изображения на компьютере. Производители видеокарт и других комплектующих к ПК сейчас вовсю трудятся над проблемой некачественного вывода изображения на мониторы. И, надо сказать, что они уже довольно далеко продвинулись. Остается самая малость, и изображение на мониторе станет идеальным. Но это все - лирическое отступление. Вернемся к нашей основной теме.

Немного истории

Многие и мониторов активно пытались побороть тиринг и улучшить изображение. Что только они не изобретали: повышали «герцовость» монитора, включали V-Sync. Ничего не помогало. И в один прекрасный день известный производитель видеокарт NVIDIA презентует технологию G-Sync, с помощью которой можно добиться «нереальной» плавности изображения без всяких артефактов. Вроде бы и хорошо, но имеется одно маленькое, но очень серьезное «но». Для пользования этой опцией нужны мониторы с поддержкой G-Sync. Пришлось поднапрячься производителям мониторов и «выбросить» на рынок пару десятков моделей. А что дальше? Давайте рассмотрим технологию и попробуем разобраться, так ли она хороша.

Что собой представляет G-Sync?

G-Sync - технология вывода на экран от компании NVIDIA. Характеризуется плавностью смены кадров без всяческих артефактов. Нет ни разрывов изображения, ни подтормаживаний. Для адекватной работы сей технологии требуется довольно мощный компьютер, поскольку для обработки цифрового сигнала нужны немаленькие мощности процессора. Именно поэтому технологией снабжаются только новые модели видеокарт от NVIDIA. Кроме того, G-Sync - фирменная фишка NVIDIA, поэтому владельцам видеокарт от других производителей ничего не светит.

Кроме требуется G-Sync-монитор. Дело в том, оснащены платой с преобразователем цифрового сигнала. Владельцы обычных мониторов не смогут воспользоваться этой восхитительной опцией. Несправедливо, конечно, но такова политика современных производителей - выкачать как можно больше денег из бедного пользователя. Если конфигурация вашего ПК позволяет использовать G-Sync, и монитор чудом поддерживает эту опцию, то вы вполне можете оценить все прелести данной технологии.

Принцип работы G-Sync

Попробуем упрощенно объяснить принцип работы G-Sync. Дело в том, что обычный GPU (видеокарта) просто посылает цифровой сигнал на монитор, но не считается с его частотой. Именно поэтому сигнал при выводе на экран получается «рваным». Сигнал, идущий от GPU, прерывается частотой монитора и выглядит неказисто в конечном варианте. Даже с включенной опцией V-Sync.

При использовании G-Sync GPU сам регулирует частоту монитора. Именно поэтому сигналы доходят до матрицы тогда, когда это действительно нужно. Благодаря этому появляется возможность избежать разрывов изображения и повысить плавность картинки в целом. Поскольку обычные мониторы не позволяют GPU управлять собой, был придуман G-Sync-монитор, в который внедрена плата от NVIDIA, регулирующая частоту. Поэтому использование обычных мониторов невозможно.

Мониторы с поддержкой этой технологии

Ушли в прошлое те времена, когда пользователи убивали свое зрение, часами глядя в древние ЭЛТ-мониторы. Теперешние модели отличаются элегантностью и безвредностью. Так почему бы не добавить им немного новых технологий? Первый монитор с поддержкой NVIDIA G-Sync и разрешением 4К был выпущен компанией Acer. Новинка произвела изрядный фурор.

Пока еще качественные мониторы с G-Sync довольно редки. Но в планах у производителей имеется задумка сделать эти устройства стандартными. Скорее всего, через пять лет мониторы с поддержкой данной технологии станут стандартным решением даже для офисного ПК. Ну а пока остается только поглядывать на эти новинки и ждать их повсеместного распространения. Именно тогда они подешевеют.

После этого мониторы с поддержкой G-Sync начали клепать все, кому не лень. Появились даже бюджетные модели с этой технологией. Хотя что толку от этой технологии на бюджетном экране с плохой матрицей? Но, как бы то ни было, такие модели имеют место. Оптимальным вариантом для данной опции является (G-Sync на нем работать будет в полную силу).

Лучшие мониторы с G-Sync

Мониторы с технологией G-Sync выделяются в особую линейку устройств. Они должны обладать характеристиками, нужными для полноценной работы данной опции. Понятно, что далеко не все экраны справятся с такой задачей. Уже сейчас определились несколько лидеров по производству таких мониторов. Их модели получились очень удачными.

К примеру, монитор G-Sync относится к ярким представителям данной линейки. Это устройство относится к премиум-классу. Почему? Судите сами. Диагональ экрана составляет 34 дюйма, разрешение - 4К, контрастность - 1:1000, 100 Гц, время отклика матрицы - 5 мс. К тому же Многие хотели бы заполучить себе этого «монстра». Понятно, что он будет на ура справляться с технологией G-Sync. Ему пока нет аналогов. Можно спокойно назвать его лучшим в своем классе и не ошибиться.

Вообще, G-Sync мониторы ASUS сейчас находятся на вершине "Олимпа". Еще ни один производитель не смог переплюнуть эту компанию. И вряд ли когда-нибудь это получится. ASUS можно назвать первопроходцем в этом плане. Их мониторы, поддерживающие G-Sync, разлетаются, как горячие пирожки.

Будущее G-Sync

Сейчас технологию G-Sync активно пытаются внедрить в ноутбуки. Некоторые производители даже выпустили пару таких моделей. Причем они могут работать без платы G-Sync в мониторе. Что и понятно. Все-таки у ноутбука несколько другие конструктивные особенности. Там вполне достаточно видеокарты с поддержкой данной технологии.

Вероятно, вскоре изрядное место в компьютерной промышленности займет именно NVIDIA G-Sync. Мониторы с этой технологией должны подешеветь. В конце концов эта опция должна стать повсеместно доступна. Иначе какой смысл в ее разработке? В любом случае пока все не так радужно. Есть некоторые проблемы по внедрению G-Sync.

В будущем технология G-Sync станет такой же обыденной вещью, которой был для нас когда-то VGA-порт для подключения монитора. А вот всяческие «вертикальные синхронизации» на фоне этой технологии выглядят вопиющим анахронизмом. Мало того что эти устаревшие технологии не могут обеспечить удовлетворительное качество картинки, так они еще и «кушают» немалое количество системных ресурсов. Определенно, с появлением G-Sync их место на помойке истории.

Методика тестирования

Монитор ASUS ROG SWIFT PG278Q был протестирован по нашей новой методике. Мы решили отказаться от медлительного и порой неточного Spyder4 Elite в пользу более быстрого и точного колориметра X-Rite i1Display Pro. Теперь для измерения основных параметров дисплея будет использоваться этот колориметр совместно с программным комплексом Argyll CMS последней версии. Все операции будут осуществляться в Windows 8. Во время тестирования частота обновления экрана составляет 60 Гц.

В соответствии с новой методикой мы измерим следующие параметры монитора:

- Яркость белого при мощности подсветки от 0 до 100% с шагом 10%;

- Яркость чёрного при мощности подсветки от 0 до 100% с шагом 10%;

- Контрастность дисплея при мощности подсветки от 0 до 100% с шагом в 10%;

- Цветовой охват;

- Цветовую температуру;

- Гамма-кривые трёх основных цветов RGB;

- Гамма-кривую серого цвета;

- Delta E (по стандарту CIEDE2000).

Для калибровки и анализа Delta E применяется графический интерфейс для Argyll CMS — DispcalGUI, последней версии на момент написания статьи. Все описанные выше измерения проводятся до и после калибровки. Во время тестов мы измеряем основные профили монитора — выставленный по умолчанию, sRGB (если доступен) и Adobe RGB (если доступен). Калибровка проводится в профиле, выставленном по умолчанию, за исключением особых случаев, о которых будет сказано дополнительно. Для мониторов с расширенным цветовым охватом мы выбираем режим аппаратной эмуляции sRGB, если он доступен. В последнем случае цвета конвертируются по внутренним LUT монитора (которые могут иметь разрядность вплоть до 14 бит на канал) и выводятся на 10-битную матрицу, в то время как попытка сузить цветовой охват до границ sRGB инструментами цветокоррекции ОС приведёт к снижению точности кодирования цвета. Перед началом всех тестов монитор прогревается в течение часа, а все его настройки сбрасываются до заводских.

Также мы продолжим нашу старую практику публикации профилей калибровки для протестированных нами мониторов в конце статьи. При этом тестовая лаборатория 3DNews предупреждает, что такой профиль не сможет на 100% исправить недостатки конкретно вашего монитора. Дело в том, что все мониторы (даже в рамках одной модели) обязательно будут отличаться друг от друга своими небольшими погрешностями цветопередачи. Изготовить две одинаковые матрицы невозможно физически — слишком уж они сложны. Поэтому для любой серьёзной калибровки монитора необходим колориметр или спектрофотометр. Но и «универсальный» профиль, созданный для конкретного экземпляра, в целом может поправить ситуацию и у других устройств той же модели, особенно в случае дешёвых дисплеев с ярко выраженными дефектами цветопередачи.

Углы обзора, равномерность подсветки

Первое, что интересовало нас в ASUS PG278Q, это углы обзора, ведь в мониторе используется TN-матрица — её самые большие проблемы всегда связаны с ними. К счастью, все оказалось не так уж плохо. Конечно, у IPS-матриц углы обзора побольше, но и ASUS PG278Q не приходилось часто поворачивать, чтобы устранить искажения контраста и цветопередачи.

А вот проблем с засветкой экрана разработчикам ASUS PG278Q избежать не удалось. У монитора есть небольшая засветка по всем четырём углам и в верхней части. Если на дисплее запущена игра, то разглядеть засветку будет непросто, но стоит запустить какой-нибудь фильм в тёмной комнате (с обычными вертикальными чёрными полосами сверху и снизу) — и дефект сразу становится заметным.

Тестирование без калибровки

Максимальная яркость у ASUS PG278Q составила 404 кд/м 2 — даже больше, чем обещает производитель. Столь высокое значение оправдано поддержкой 3D, ведь при использовании активных затворных очков воспринимаемая яркость монитора может упасть в два раза. Максимальная яркость чёрного поля составила 0,40 кд/м 2 , что тоже весьма неплохо. В результате статическая контрастность колеблется около значения 1000:1 на всём диапазоне яркости подсветки. Отличный результат — столь высокая контрастность характерна для качественных IPS-матриц. MVA, правда, вне досягаемости.

С цветовым охватом у нашего подопытного всё настолько хорошо, насколько требуется. Цветовое пространство sRGB покрыто на 107,1%. Точка белого находится рядом с эталонной точкой D65.

Если говорить об играх, то с цветовой палитрой у ASUS PG278Q полный порядок, а вот с профессиональной обработкой фото могут быть проблемы из-за немного перенасыщенных цветов в силу избыточного цветового охвата по сравнению с sRGB. Впрочем, рассматриваемый нами дисплей предназначен как раз для игр, поэтому не стоит обращать много внимания на этот недостаток.

Цветовая температура ASUS PG278Q в ходе измерений держалась на уровне 6 000 К, что на 500 К ниже нормы. Это значит, что у светлых цветов может быть заметен лёгкий тёплый оттенок.

|

|

|

Только гамма-кривая красного цвета оказалась недалеко от эталона, а кривые синего и зелёного просели, хотя и старались держаться вместе. При этом с гаммой серого у монитора дела идут практически хорошо. При измерении тёмных тонов она практически не отклоняется от эталонной кривой, а при переходе к светлым — отходит, но не сильно.

Среднее значение показателя точности цветопередачи Delta E составило 2,08 единицы, а максимальное — 7,07 единицы. Результаты, конечно, не самые лучшие, но, во-первых, ASUS PG278Q все-таки предназначен для игр, а не для обработки фото, во-вторых, для TN-матрицы полученные нами результаты вполне удовлетворительны.

Тестирование после калибровки

Обычно после калибровки яркость белого падает, причём очень сильно — на 10% и более, даже у вполне качественных панелей. В случае с ASUS PG278Q она упала примерно на 3% — до 391 кд/м 2 . Яркость чёрного поля аппаратная калибровка не затронула. Как результат, статическая контрастность снизилась до 970:1.

Калибровка практически не повлияла на цветовой охват, а вот точка белого вернулась на положенное ей место, пускай и сдвинулась лишь совсем чуть-чуть.

После калибровки цветовая температура немного поднялась, но до эталонной не дотянула. Теперь разрыв между измеренным и эталонным значением составил примерно 100—200 К вместо 500 К, что, впрочем, вполне терпимо.

Положение трёх основных гамма-кривых, к сожалению, почти не изменилось после калибровки, тогда как гамма серого стала выглядеть немного лучше.

|

|

|

А вот на точности цветопередачи калибровка сказалась лучше всего. Cреднее значение Delta E опустилось до 0,36 единицы, максимальное — до 1,26 единицы. Великолепные результаты для любой матрицы, а уж для TN+Film — просто фантастика.

Тестирование G-Sync: методика

В руководстве по G-Sync от NVIDIA приведены настройки для тестирования в нескольких играх, при которых количество кадров в секунду будет колебаться между 40 и 60 FPS. Именно в таких условиях при частоте обновления 60 Гц возникает больше всего «фризов» со включенным V-Sync. Для начала мы сравним три сценария использования: с V-Sync, без него и с G-Sync — все на частоте 60 Гц.

Но вспомним, что подъём частоты обновления с 60 до 120/144 Гц сам по себе делает разрывы менее заметными без вертикальной синхронизации, а с V-Sync уменьшает «фризы» с 13 до 8/7 мс соответственно. Есть ли реальная польза от G-Sync по сравнению с V-Sync на частоте 144 Гц? Проверим и это.

Хотелось бы особо отметить, что, если верить описанию, в случае G-Sync частота обновления совершенно не имеет смысла. Поэтому не вполне корректно говорить, что мы, к примеру, сравнили V-Sync и G-Sync на частоте 60 Гц. V-Sync действительно был на частоте 60 Гц, а G-Sync означает обновление экрана по требованию, а не с определённым периодом. Но даже при включённом G-Sync мы все ещё можем выбирать частоту обновления экрана в панели управления драйвером. При этом FRAPS в играх при активации G-Sync показывает, что действует именно такой потолок частоты кадров, как если бы работал V-Sync. Получается, что эта настройка регулирует минимальное время жизни кадра и, соответственно, интервал обновления экрана. Грубо говоря, задаётся диапазон частот, в котором оперирует монитор, — от 30 до 60-144 Гц.

Для того чтобы включить G-Sync, необходимо зайти в панель управления NVIDIA, найти соответствующую ссылку в левом углу экрана и поставить галочку около единственного чекбокса. Технология поддерживается в драйверах для ОС Windows 7 и 8.

Затем надо убедиться, что в разделе «Настройки 3D» также включен G-Sync — его можно найти в подменю Vertical Sync.

На этом всё: функция G-Sync включилась для всех игр, запущенных в полноэкранном режиме, — в окне эта функция пока ещё работать не умеет. Для тестирования мы использовали стенд с графической картой GeForce GTX TITAN Black.

Испытания проводились в играх Assasin’s Creed: Black Flag, а также в Counter-Strike: Global Offensive. Новую технологию мы тестировали двумя способами: просто играли, а затем устроили охоту на разрывы с помощью скрипта, который плавно перемещал игровую камеру, то есть «двигал мышкой» по горизонтали. Первый способ позволял оценить ощущения от G-Sync «в бою», а второй — более наглядно увидеть разницу между включенной/выключенной вертикальной синхронизацией и G-Sync.

G-Sync в Assasin’s Creed: Black Flag, 60 Гц

Без V-Sync и G-Sync при частоте 60 Гц разрывы были отлично заметны почти при любом движении камеры.

Разрыв заметен в правой верхней части кадра, около мачты корабля

При включении V-Sync разрывы изображения пропали, но появились «фризы», что не пошло на пользу геймплею.

Двоящаяся мачта корабля на фото — один из признаков «фриза»

После включения G-Sync разрывы и «фризы» пропали полностью, игра стала работать плавнее. Конечно, периодическое уменьшение частоты кадров до 35—40 FPS было заметно, но благодаря синхронизации дисплея и видеокарты не вызывало столь ощутимых тормозов, как с вертикальной синхронизацией.

Однако, как говорится, лучше один раз увидеть, чем сто раз услышать, поэтому мы сделали короткое видео, на котором показана работа новых «Ассасинов» с включённой и выключенной вертикальной синхронизацией, а также с G-Sync. Конечно, видео не может передать «живые» впечатления полностью хотя бы из-за съёмки на частоте 30 кадров в секунду. Кроме того, камера «видит» мир иначе, чем глаз человека, поэтому на видео могут быть заметны артефакты, которые в реальном мире не разглядеть, — например, двоение изображения. Тем не менее мы постарались сделать это видео максимально наглядным: по крайней мере наличие или отсутствие разрывов на нём вполне заметно.

Теперь запустим Assasin’s Creed: Black Flag с минимальными настройками и посмотрим, что изменилось. Количество кадров в секунду в таком режиме игры не превышало 60 FPS — выставленной частоты обновления экрана. Без включённой вертикальной синхронизации на экране были заметны разрывы. Но стоило включить V-Sync, как разрывы пропали и «картинка» стала выглядеть практически так же, как и при G-Sync.

При выставлении максимальных настроек графики количество кадров в секунду стало колебаться около 25—35 FPS. Разумеется, сразу же вернулись разрывы без V-Sync и «фризы» с ним. Исправить эту ситуацию не смогло даже включение G-Sync — при таком низком количестве FPS тормоза порождает уже сам GPU.

G-Sync в Assasin’s Creed: Black Flag, 144 Гц

При отключенных V-Sync и G-sync на экране можно было найти разрывы, но благодаря частоте обновления 144 Гц их стало гораздо меньше, чем раньше. При включении V-Sync пропадали разрывы, но чаще стали встречаться «фризы» — почти как и при частоте обновления экрана в 60 Гц.

Включение G-Sync , как и раньше, смогло исправить ситуацию, но самое сильное улучшение картинки было заметно лишь при высокой частоте кадров — от 60 FPS и выше. Вот только без снижения настроек или добавления второй видеокарты уровня GeForce GTX Titan Black достичь такой высокой частоты кадров не получалось.

G-Sync в Counter-Strike: Global Offensive, 60 и 144 Гц

В сетевых играх на игровой процесс и качество изображения влияют не только видеокарта и монитор, но и пинг — чем он выше, тем больше задержка «отклика» игры. Во время наших тестов пинг находился на уровне 25—50 мс, а частота кадров во время теста колебалась около 200 FPS.

Настройки изображения, использованные в Counter-Strike: Global Offensive

Без использования G-Sync и V-Sync в CS, как и в Assasin’s Creed, наблюдались разрывы. При включении V-Sync при частоте 60 Гц играть стало сложнее — частота кадров упала до 60 FPS, да и бегать игровой персонаж стал неровно из-за большого количества «фризов».

При включении G-Sync фреймрейт так и остался на уровне 60 кадров в секунду, но «фризов» стало гораздо меньше. Нельзя сказать, что они пропали совсем, но портить впечатление от игры перестали.

Теперь увеличим частоту обновления экрана и посмотрим, что изменится. При отключенных G-Sync и V-Sync на 144 Гц разрывов стало гораздо меньше, чем при 60 Гц, но полностью они не исчезли. Зато при включении V-Sync пропали все разрывы, а «фризы» стали практически незаметными: играть в таком режиме очень комфортно, да и скорость передвижения не снижается. Включение G-Sync и вовсе превратило изображение в конфетку: геймплей стал настолько плавным, что даже 25-мс пинг стал сильно влиять на игровой процесс.

Тестирование режима ULMB

Ultra Low Motion Blur включается из меню монитора, но предварительно требуется отключить G-Sync и выставить частоту обновления экрана на отметке 85, 100 или 120 Гц. Более низкие или высокие частоты не поддерживаются.

Практическое применение этой «фишки» очевидно: текст на сайтах меньше смазывается во время прокрутки, а в стратегиях и прочих RTS-играх движущиеся юниты выглядят более детально.

ASUS ROG SWIFT PG278Q в 3D

ASUS ROG SWIFT PG278Q — первый в мире монитор, способный воспроизводить стереоскопическую картинку при разрешении 2560х1440 благодаря интерфейсу DisplayPort 1.2. Тоже, в принципе, немаленькое достижение. К сожалению, у монитора нет встроенного ИК-трансмиттера, поэтому мы взяли трансмиттер из комплекта NVIDIA 3D Vision, а очки — из комплекта 3D Vision 2. Такая связка заработала без проблем, и мы смогли протестировать стереоскопическое 3D как следует.

Никакого эффекта ghosting и прочих артефактов, встречающихся у псевдообъёмного видео, мы не нашли. Разумеется, иногда в играх некоторые объекты находились на неправильной глубине, но к недостаткам монитора это отнести никак нельзя. На ASUS PG278Q можно как смотреть стереофильмы, так и играть в подобные игры. Главное — чтобы видеоадаптер потянул.

⇡ Выводы

Нисколько не желая приуменьшить достижения NVIDIA, нужно заметить, что в целом G-Sync — это такое новшество, которое сводится к избавлению от давнего и вредоносного атавизма — регулярного обновления LCD-панелей, которые в нём изначально не нуждаются. Оказалось, что для этого достаточно внести небольшие изменения в протокол DisplayPort, которые по щелчку пальцев попали в спецификацию 1.2a и, если верить обещаниям AMD, уже очень скоро найдут применение в контроллерах дисплея от многих производителей.

Пока, однако, доступна только проприетарная версия этого решения в виде G-Sync, которую мы имели удовольствие протестировать в мониторе ASUS ROG SWIFT PG278Q. Ирония в том, что это как раз такой монитор, для которого преимущества от G-Sync не очень-то заметны. Обновление экрана на частоте 144 Гц само по себе сокращает количество пресловутых разрывов настолько, что многие будут готовы закрыть глаза на эту проблему. А при вертикальной синхронизации мы имеем менее выраженные «фризы» и задержку ввода по сравнению с 60-Гц экранами. G-Sync в такой ситуации может только довести плавность игры до идеала.

И все же синхронизация обновления экрана с рендерингом кадров на GPU по-прежнему является более изящным и экономным решением, чем постоянное обновление на сверхвысокой частоте. Также не будем забывать, что применение G-Sync не ограничивается матрицами с частотой 120/144 Гц. В первую очередь приходят на ум 4К-мониторы, которые пока ограничены частотой 60 Гц как по спецификациям матриц, так и по пропускной способности видеовходов. Затем — мониторы на IPS, также не имеющие возможности перейти на 120/144 Гц в силу ограничений самой технологии.

При частоте обновления 60 Гц эффект G-Sync невозможно преувеличить. Если частота смены кадров постоянно превышает 60 FPS, то простая вертикальная синхронизация избавляет изображение от разрывов столь же успешно, но только G-Sync может сохранить плавную подачу кадров при падении фреймрейта ниже частоты обновления. Кроме того, благодаря G-Sync диапазон производительности 30-60 FPS становится намного более играбельным, что либо снижает требования к производительности GPU, либо позволяет выставить более агрессивные настройки качества. И снова мысль возвращается к 4К-мониторам, для игры на которых с хорошей графикой необходимо крайне мощное железо.

Также похвально, что NVIDIA применила технологию пульсирующей подсветки для удаления размытия движущихся объектов (ULMB), с которой мы ранее познакомились на примере EIZO Foris FG2421 . Жалко, что пока она не может работать одновременно с G-Sync.

Сам монитор ASUS ROG SWIFT PG278Q хорош в первую очередь сочетанием разрешения 2560x1440 и частоты обновления 144 Гц. Ранее устройств с такими параметрами на рынке не было, а между тем игровым мониторам со столь низким временем отклика и поддержкой стереоскопического 3D давно пора вырасти из формата Full HD. К тому, что в PG278Q установлена TN-матрица, сильно придираться не стоит, ибо это действительно хороший экземпляр с высочайшей яркостью, контрастностью и отличной цветопередачей, которому после калибровки позавидуют и дисплеи на IPS. Технологию выдают разве что ограниченные углы обзора. Не оставим без похвалы и дизайн, подобающий такому качественному продукту. ASUS ROG SWIFT PG278Q получает заслуженную награду «Выбор редакции» — настолько он оказался хорош.

Рекомендовать этот игровой монитор к покупке без лишних раздумий мешает только цена в районе 30 тысяч рублей. Кроме того, на момент написания этой статьи ASUS ROG SWIFT PG278Q всё ещё не продаётся в РФ, поэтому увидеть его, а также и G-Sync, своими глазами негде. Но мы надеемся, что компании ASUS и NVIDIA в будущем решат эту проблему — например, показывая G-Sync на выставках компьютерных игр. Ну и цена, однажды, наверное, снизится...

С файлового сервера сайт можно скачать цветовой профиль для этого монитора, который мы получили после калибровки.

Редакция сайт благодарит компанию «Графитек » за предоставленный колориметр X-Rite i1Display Pro.

Обзор технологии G-Sync | Тестирование G-Sync с отключённой V-Sync

Выводы в этом материале созданы на основе опроса авторов и друзей Tom"s Hardware по Skype (другими словами, выборка опрашиваемых небольшая), но почти все они понимают, что такое вертикальная синхронизация и с какими недостаткам приходится в той связи мириться пользователям. По их словам, они прибегают к помощи вертикальной синхронизации лишь в том случае, когда разрывы из-за сильно большого разброса в частоте кадров и частоте обновления монитора становятся невыносимыми.

Как вы можете себе представить, влияние выключенной вертикальной синхронизации на визуальную составляющую сложно перепутать, хотя на это сильно влияют конкретная игра и её настройки детализации.

Возьмём, например, Crysis 3 . Игра с лёгкостью может поставить на колени вашу графическую подсистему на самых высоких параметрах графики. И, поскольку Crysis 3 является шутером от первого лица с очень динамичным геймплеем, разрывы могут быть довольно ощутимыми. На примере выше вывод FCAT был захвачен между двумя кадрами. Как видите, дерево полностью разрезано.

С другой стороны, когда мы принудительно отключаем вертикальную синхронизацию в Skyrim, разрывы не такие уж и сильные. Учтите, что в этом случае частота кадров очень высокая, и несколько кадров появляются на экране с каждым сканированием. Таким обзорам, количество движений на кадр относительно низкое. При игре в Skyrim в такой конфигурации существуют проблемы, и, возможно, она не самая оптимальная. Но она показывает, что даже при отключённой вертикальной синхронизации ощущение от игры может меняться.

В качестве третьего примера мы выбрали кадр с изображением плеча Лары Крофт из игры Tomb Raider, на котором виден довольно чёткий разрыв изображения (также посмотрите на волосы и лямку майки). Tomb Raider – единственная игра из нашей выборки, которая позволяет выбирать между двойной и тройной буферизацией при активации вертикальной синхронизации.

Последний график показывает, что Metro: Last Light с G-Sync при 144 Гц, в целом, обеспечивает такую же производительность, как при отключённой вертикальной синхронизации. Однако на графике нельзя увидеть отсутствие разрывов. Если использовать технологию с экраном 60 Гц, частота кадров упрётся в 60 FPS, но при этом не будет притормаживаний или задержек.

Во всяком случае, те из вас (и нас), кто провёл несчётное количество времени за графическими тестами, наблюдая один и тот же бенчмарк снова и снова, могли привыкнуть к ним и визуально определить, насколько хорош тот или иной результат. Так мы измеряем абсолютную производительность видеокарт. Изменения в картинке с активной G-Sync сразу бросаются в глаза, поскольку появляется плавность, как при включённой V-sync, но без разрывов, свойственных для отключённой V-sync. Жаль, что сейчас мы не можем показать разницу в видеоролике.

Обзор технологии G-Sync | Совместимость с играми: почти великолепно

Проверяем другие игры

Мы протестировали ещё несколько игр. Crysis 3 , Tomb Raider, Skyrim, BioShock: Infinite, Battlefield 4 побывали на тестовом стенде. Все они, кроме Skyrim, выиграли от технологии G-Sync . Эффект зависел от конкурентной игры. Но если бы вы видели его, сразу бы признали, что игнорировали недостатки, которые присутствовали ранее.

Артефакты всё же могут появляться. Например, эффект сползания, связанный со сглаживанием, при плавном движении заметен сильнее. Скорее всего, вам захочется выставить сглаживание как можно выше, чтобы убрать неприятные неровности, которые раньше были не так заметны.

Skyrim: особый случай

Графический движок Creation, на котором разработана Skyrim, активирует вертикальную синхронизацию по умолчанию. Чтобы тестировать игру на частоте кадров выше 60 FPS, в один из.ini-файлов игры нужно добавить строку iPresentInterval=0.

Таким образом, Skyrim можно тестировать тремя способами: в исходном состоянии, позволяя драйверу Nvidia "использовать настройки приложения ", включить G-Sync

в драйвере и оставить настройки Skyrim нетронутыми, а затем включить G-Sync

и отключить V-sync в файле игры с расширением.ini.

Первая конфигурация, в которой опытный монитор выставлен на 60 Гц, показала стабильные 60 FPS на ультранастройках с видеокартой GeForce GTX 770 . Следовательно, мы получили плавную и приятную картинку. Тем не менее, ввод от пользователя по-прежнему страдает от задержки. Кроме того, стрейф из стороны в сторону выявил заметное размытие движений. Однако именно таким образом на ПК играет большинство людей. Конечно, вы можете купить экран с частотой обновления 144 Гц, и он реально устранит размытие. Но поскольку GeForce GTX 770 обеспечивает частоту обновления на уровне примерно 90 - 100 кадров в секунду, появятся ощутимые притормаживания, когда движок будет колебаться между 144 и 72 FPS.

При 60 Гц G-Sync имеет негативное влияние на картинку, вероятно, это связано с активной вертикальной синхронизацией, при том, что технология должна работать с отключённой V-sync. Теперь боковой стрейф (особенно ближе к стенам) приводит к выраженным притормаживаниям. Это потенциальная проблема для 60-герцевых панелей с G-Sync , по крайней мере, в таких играх как Skyrim. К счастью, в случае с монитором Asus VG248Q можно переключиться в режим 144 Гц, и, несмотря на активную V-sync, G-Sync будет работать на такой частоте кадров без нареканий.

Полное отключение вертикальной синхронизации в Skyrim приводит к более "чёткому" управлению мышью. Однако при этом появляются разрывы изображения (не говоря о других артефактах, таких как мерцающая вода). Включение G-Sync оставляет притормаживания на уровне 60 Гц, но на 144 Гц ситуация значительно улучшается. Хотя в обзорах видеокарт мы тестируем игру с отключённой вертикальной синхронизацией, мы не рекомендовали бы играть без неё.

Для Skyrim, возможно, самым лучшим решением будет отключить G-Sync и играть на 60 Гц, что даст постоянные 60 кадров в секунду на выбранных вам настройках графики.

Обзор технологии G-Sync | G-Sync – то, что вы ждали?

Даже перед тем, как мы получили тестовый образец монитора Asus с технологий G-Sync , нас уже порадовал тот факт, что Nvidia работает над вполне реальной проблемой, влияющей на игры, решения которой ещё не было предложено. До сих пор вы на свой вкус могли включать или не включать вертикальную синхронизацию. При этом любой решение сопровождалось компромиссами, негативно влияющими на игровой опыт. Если вы предпочитаете не включать вертикальную синхронизацию до тех пор, пока разрывы изображения станут невыносимыми, то можно сказать, что вы выбираете меньшее из двух зол.

G-Sync решает проблему, предоставляя монитору возможность сканировать экран на переменной частоте. Такие инновации – единственный способ и дальше продвигать нашу индустрию, сохраняя техническое преимущество персональных компьютеров над игровыми консолями и платформами. Nvidia, без сомнения, выдержит критику за то, что не разработала стандарт, который могли бы применить конкуренты. Тем не менее, для своего решения компания использует DisplayPort 1.2. В результате всего через два месяца после анонса технологии G-Sync она оказалась у нас в руках.

Вопрос в том, реализует ли Nvidia всё, что обещала в G-Sync?

Три талантливых разработчика, расхваливающие качества технологии, которую вы ещё не видели в действии, могут вдохновить кого угодно. Но если ваш первый опыт с G-Sync основан на демонстрационном тесте с маятником от Nvidia, вы точно зададитесь вопросом, возможна ли вообще такая огромная разница, или же тест представляет особый сценарий, который слишком хорош, чтобы быть правдой.

Естественно, при проверке технологии в реальных играх эффект оказывается не таким однозначным. С одной стороны, были возгласы "Ого!" и "С ума сойти!", с другой - "Кажется, я вижу разницу". Лучше всего влияние активации G-Sync заметно при смене частоты обновления дисплея с 60 Гц на 144 Гц. Но мы также пытались провести тест на 60 Гц с G-Sync , чтобы узнать, что вы получите (надеемся) с более дешёвыми дисплеями в будущем. В некоторых случаях простой переход с 60 на 144 Гц вас сильно поразит, особенно если ваша видеокарта может обеспечить высокую частоту кадров.

Сегодня нам известно, что Asus планирует внедрить поддержку G-Sync

в модели Asus VG248QE

, которая, по словам компании, в следующем году будет продаваться по цене $400. Монитор имеет родное разрешение 1920x1080 пикселей и частоту обновления 144 Гц. Версия без G-Sync

уже получила нашу награду Smart Buy за выдающуюся производительность. Но лично для нас 6-битная TN-панель является недостатком. Очень хочется видеть 2560x1440 пикселей на IPS-матрице. Мы даже согласны на частоту обновления 60 Гц, если это поможет снизить цену.

Хотя на выставке CES мы ждём целую кучу анонсов, официальных комментариев Nvidia касательно других дисплеев с модулями G-Sync и их цен мы не слышали. Кроме того, мы не уверены, каковы планы компании насчёт модуля для апгрейда, который должен позволить вам внедрить модуль G-Sync в уже купленный монитор Asus VG248QE за 20 минут.

Сейчас мы можем сказать, что стоит подождать. Вы увидите, что в одних играх влияние новой технологий нельзя перепутать, а в других оно менее выражено. Но в любом случае G-Sync отвечает на "бородатый" вопрос, включать или не включать вертикальную синхронизацию.

Есть ещё одна интересная мысль. После того, как мы протестировали G-Sync , сколько ещё AMD сможет уклоняться от комментариев? Компания подразнила наших читателей в своём интервью (англ.), отметив, что она скоро определиться с этой возможностью. Если у неё что-нибудь в планах? Конец 2013 года и начало 2014 года готовят нам множество интересных новостей для обсуждения, включая Battlefield 4 Mantle-версии, предстоящую архитектуру Nvidia Maxwell, G-Sync , движок AMD xDMA с поддержкой CrossFire и слухи о новых двухчиповых видеокартах. Сейчас нам не хватает видеокарт, объём памяти GDDR5 которых больше чем 3 Гбайт (Nvidia) и 4 Гбайт (AMD), но стоят они меньше $1000...